多変量解析の落とし穴:多重共線性とその対処

デジタル化を知りたい

先生、『マルチコ処理』ってどういう意味ですか?デジタル化(DX)の勉強で出てきたのですが、変数カテゴリ間(同じ変数を除く)の相関係数とかVIF値が高いものを削除するって書いてあって、よくわからないんです。

デジタル化研究家

なるほど。『マルチコ処理』は『多重共線性』を処理することだね。簡単に言うと、似たような情報を持つ変数が複数あると、統計の分析結果がおかしくなることがあるんだ。だから、似たような変数を減らす処理をするんだよ。

デジタル化を知りたい

似たような情報を持つ変数って、具体的にどういうことですか?

デジタル化研究家

例えば、商品の『売上高』と『販売個数』は、どちらも商品の売れ行きを表すよね?こういう似た情報を持つ変数を同時に分析に使うと、結果が不安定になったりする。だから、相関係数やVIF値を見て、どちらか一方を削除する、といった処理をするんだ。これがマルチコ処理だよ。

マルチコ処理とは。

複数の種類のデータを変換する取り組みの中で、それぞれのデータの種類に含まれる個々の項目同士の関係性を調べます。もし、異なる種類のデータの項目同士で関係が強すぎるもの(同じ項目は除く)が見つかった場合、相関係数やVIFと呼ばれる数値が高い状態になっていると考えられます。このような項目は、重複した情報を持っている可能性が高いため、片方を削除します。

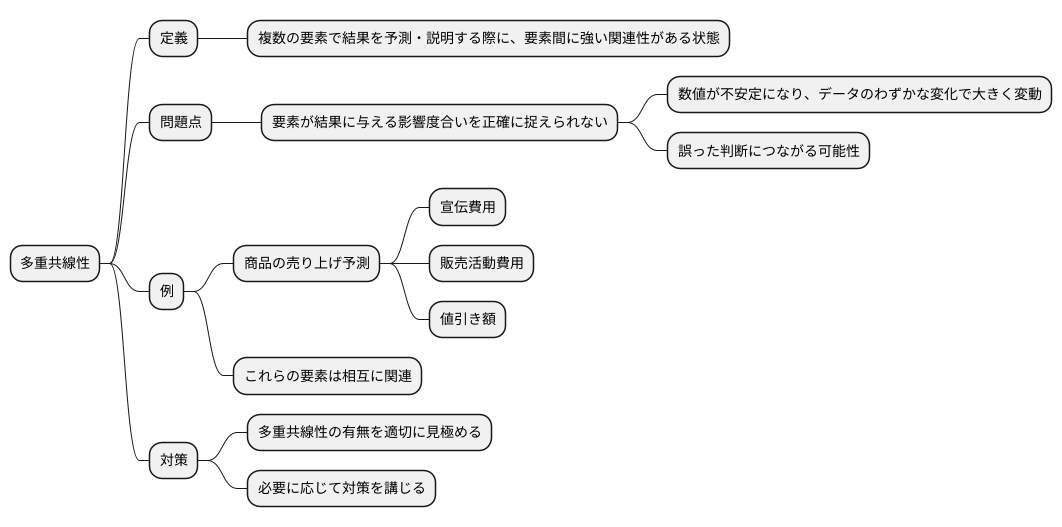

多重共線性とは

複数の要素を用いて結果を予測したり、説明したりする手法は、様々な分野で活用されています。しかし、これらの要素同士に強い関連性があると、分析結果の信頼性が揺らぎかねません。この問題こそが、多重共線性と呼ばれるものです。

例を挙げると、ある商品の売り上げを予測するために、宣伝費用、販売活動費用、値引き額といった要素を用いるとします。これらの要素は相互に関連しており、宣伝費用が増加すると、販売活動費用や値引き額も増える傾向があると考えられます。このような状況では、多重共線性が潜んでいる可能性があります。

多重共線性が存在すると、どの要素が結果にどれほどの影響を与えているかを正確に捉えることが難しくなります。具体的には、それぞれの要素の影響度を示す数値が不安定になり、データのわずかな変化で大きく変動してしまう可能性があります。まるで砂山の上に家を建てるように、基礎が不安定なため、少しの揺らぎで全体が崩れてしまう危険性があるのです。

例えば、宣伝費用と販売活動費用が共に売り上げに貢献している場合、多重共線性の影響で、それぞれの費用が売り上げに与える真の影響度合いを分離して評価することが困難になります。結果として、誤った判断を下してしまう恐れがあります。

そのため、多要素を用いた分析を行う際には、多重共線性の有無を適切に見極め、必要に応じて対策を講じることが不可欠です。多重共線性を放置すると、分析結果の信頼性を損ない、誤った結論を導き出す可能性があるため、注意深く対処する必要があります。

多重共線性の診断

複数の説明変数間に強い相関があると、回帰分析の結果に悪影響を与える「多重共線性」と呼ばれる問題が発生します。この問題に対処するには、まず多重共線性が存在するかどうかを診断する必要があります。主な診断方法として、相関係数と分散膨張係数を使う方法が挙げられます。

相関係数は、二つの変数の間の直線的な関係の強さを測る指標です。この値は-1から1までの範囲で、絶対値が1に近いほど二つの変数の関係は強く、多重共線性が疑われます。経験的には、相関係数の絶対値が0.7を超える場合、多重共線性に注意する必要があると考えられています。例えば、商品の価格と販売数量の相関係数を調べ、その絶対値が0.8だった場合、価格と販売数量の間には強い相関があり、多重共線性の可能性が高いと判断できます。

もう一つの指標である分散膨張係数(VIF)は、ある説明変数が他の説明変数によってどの程度説明されるかを示すものです。VIFは1以上の値を取り、値が大きいほど多重共線性が強いことを示唆します。一般的に、VIFが10を超えると、多重共線性が問題となる可能性が高いと判断されます。例えば、ある説明変数のVIFが15だった場合、その変数は他の説明変数によって強く説明されており、多重共線性の影響を強く受けていると考えられます。

ただし、これらの指標はあくまで目安であり、状況に応じて判断する必要があります。相関係数が高いからといって必ずしも多重共線性が問題になるとは限りませんし、VIFが10以下でも多重共線性の影響が無視できない場合もあります。そのため、これらの指標を用いて多重共線性の有無を慎重に判断し、必要に応じて対策を検討することが重要です。

| 診断方法 | 指標 | 基準 | 多重共線性の疑い |

|---|---|---|---|

| 相関係数 | -1 から 1 までの値 | 絶対値が 0.7 超 | あり |

| 分散膨張係数(VIF) | 1 以上の値 | 10 超 | あり |

※ これらの指標は目安であり、状況に応じて判断する必要がある。

多重共線性への対処

複数の説明変数の間に強い相関関係、つまり多重共線性があると、回帰分析の結果が不安定になり、信頼性が低下することがあります。この問題に対処するには、いくつかの方法があります。

まず、最も手軽な方法は、相関の高い説明変数の中から一つを選び、それを分析から除外することです。どの変数を除外するかは、分析の目的や変数の持つ意味、データの特性などをよく考えて慎重に判断する必要があります。重要な情報を持つ変数をうっかり除外してしまうと、分析結果の精度が下がる可能性があるからです。

次に、主成分分析などの次元削減と呼ばれる手法を用いるという方法もあります。これは、複数の説明変数をまとめて、少数の新しい変数(主成分)を作り出す方法です。それぞれの主成分は、元の説明変数の情報をなるべく損なわないように作られます。この手法を使うことで、多重共線性を解消しながら、元の説明変数が持っていた重要な情報をできるだけ維持した分析を行うことが可能になります。

さらに、正則化法を用いた回帰分析も有効な手段です。正則化法は、推定される回帰係数の大きさに制限を加えることにより、多重共線性の影響を弱める方法です。

最適な対処法は、分析の状況やデータの特性によって異なります。どの方法にも利点と欠点があるので、それぞれの特性を理解した上で、状況に合った最適な方法を選ぶことが重要です。分析の目的をよく考え、どの変数が重要なのかを慎重に見極め、適切な対処法を選びましょう。

| 対処法 | 説明 |

|---|---|

| 説明変数の除外 | 相関の高い説明変数の中から一つを選び、分析から除外する。どの変数を除外するかは、分析の目的や変数の持つ意味、データの特性などをよく考えて慎重に判断する必要がある。 |

| 次元削減(例:主成分分析) | 複数の説明変数をまとめて、少数の新しい変数(主成分)を作り出す。それぞれの主成分は、元の説明変数の情報をなるべく損なわないように作られる。 |

| 正則化法 | 推定される回帰係数の大きさに制限を加えることにより、多重共線性の影響を弱める。 |

変数削除の注意点

似たような動きをする複数の説明変数を使うと、予測の正確さが失われることがあります。これを多重共線性といいます。この問題への対策として、変数を減らす方法がよく用いられますが、いくつか注意すべき点があります。変数を減らす際は、数字的な指標だけでなく、論理的な理由も考慮しなければなりません。例えば、売上の予測モデルで、広告費と販売促進費の間に強い関連性が見られたとしても、どちらも売上を左右する重要な要素だと考えられるなら、簡単に変数を減らすべきではありません。数字の上では関連性が高くても、ビジネスの視点からはどちらも必要な変数である可能性があるからです。

変数を減らす判断基準として、相関係数や分散拡大係数(VIF)といった統計的な指標がよく使われます。しかし、これらの数値だけに頼るのではなく、それぞれの変数が持つ意味や、分析の最終的な目的を考えることが大切です。例えば、顧客満足度を予測するモデルで、商品の品質とサービスの質に高い相関があったとしても、顧客満足度を高めるためにはどちらも重要な要素である可能性があります。このような場合は、安易に変数を減らすのではなく、両方の変数をモデルに残すことを検討するべきです。変数を減らすと、モデルの予測能力が下がる可能性もあります。そのため、変数を減らす前と後で、モデルの性能を比較検証することが不可欠です。変数を減らすことで多重共線性の問題は解消されても、肝心の予測精度が落ちてしまっては意味がありません。

状況によっては、多重共線性が存在していても、予測精度が十分に高い場合があります。そのような場合は、無理に変数を減らす必要はありません。多重共線性そのものが問題なのではなく、それが予測精度に悪影響を与えるかどうかが重要です。大切なのは、多重共線性の影響を正しく見極め、分析の目的に合った最適な選択をすることです。闇雲に変数を減らすのではなく、様々な要因を考慮した上で、慎重に判断することが必要です。

| 問題点 | 対策 | 注意点 |

|---|---|---|

| 多重共線性 (似たような動きをする複数の説明変数によって予測の正確さが失われる) | 変数を減らす |

|

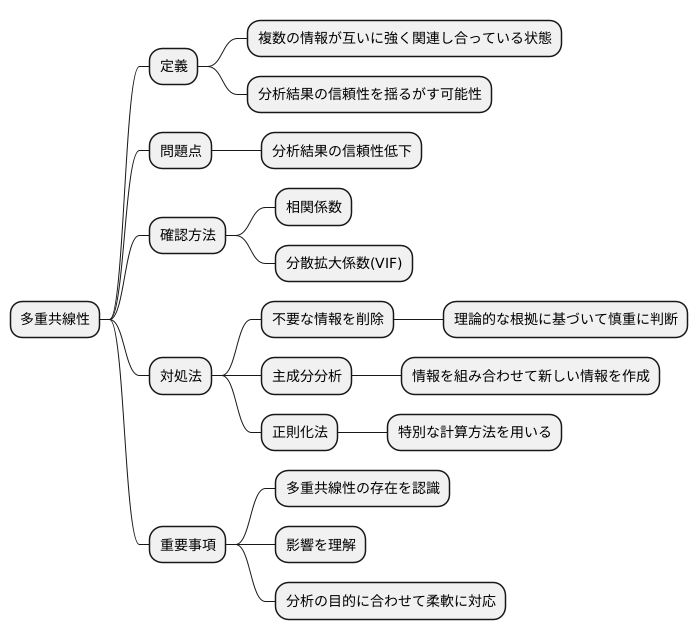

まとめ

多くの情報を同時に扱う分析では、多重共線性という問題に注意が必要となります。多重共線性とは、分析に使う複数の情報が互いに強く関連し合っている状態を指します。これは、分析結果の信頼性を大きく揺るがす可能性があるため、適切な対処が必要です。

多重共線性の有無を判断するためには、いくつかの方法があります。例えば、情報同士の関連性の強さを示す相関係数や、多重共線性の程度を示す分散拡大係数(VIF)といった指標を計算することで、多重共線性の有無を調べることができます。

もし多重共線性が認められた場合は、分析の目的に合わせて適切な対処をする必要があります。代表的な対処法としては、不要な情報を削除する方法、情報を組み合わせて新しい情報を作る主成分分析、特別な計算方法を用いる正則化法などがあります。

情報を削除する場合は、どの情報を削除するかの判断が重要です。分析の目的や情報同士の関係性をよく考えて、理論的な根拠に基づいて慎重に判断する必要があります。削除によって重要な情報が失われてしまうと、分析結果の解釈に影響が出かねません。

一方で、多重共線性の影響を必要以上に恐れる必要はありません。分析の目的によっては、多少の多重共線性は許容される場合もあります。重要なのは、多重共線性の存在を認識し、その影響を理解した上で、分析の目的に合わせて柔軟に対応することです。適切な対処を行うことで、より信頼性の高い分析結果を得ることが可能になります。