安全な学習を実現する言葉集

デジタル化を知りたい

先生、「ブラック辞書」って、悪い言葉を集めたものですよね?具体的にどんな言葉が入っているんですか?

デジタル化研究家

そうですね、人に使ってはいけない言葉が入っています。例えば、差別的な言葉や、相手を傷つけるような言葉などです。具体的にどんな言葉かと言うと、状況や文脈によって変わるので、一概には言えませんが、誰かを不快にさせる言葉は避けなければなりません。

デジタル化を知りたい

なるほど。誰かを傷つける言葉は良くないですね。でも、そういう言葉を使う人がいるから、ブラック辞書が必要なんですね。

デジタル化研究家

その通りです。デジタル化が進むと、色々な言葉が飛び交います。だからこそ、ブラック辞書のようなもので、言葉の使い方に気を付ける必要があるのです。

ブラック辞書とは。

悪い言葉やふさわしくない言葉をまとめた辞書を使って、コンピューターに良いことを教えようという話です。この辞書には、人に悪影響を与える言葉や、間違ったことを覚えさせてしまう言葉が載っています。コンピューターに何かを教えるとき、この辞書に載っている言葉は使わないようにすることで、コンピューターが安全で正しいことを学ぶようにします。

言葉集の役割

人工知能を育てるには、良い教材が欠かせません。インターネット上にはたくさんの情報がありますが、中には人を傷つける言葉や、差別につながる表現が含まれていることもあります。このような良くない情報が教材に紛れ込むと、人工知能が間違ったことを覚えたり、偏った考え方をするようになってしまいます。そのため、教材から良くない言葉を排除する仕組みが必要です。これが、良くない言葉を集めた「禁止語集」の役割です。禁止語集には、人工知能の学習に悪い影響を与える言葉が登録されています。この語集を使うことで、人工知能が安全に、そして正しく学習を進めることができます。

具体的には、人工知能に何かを学ばせる前に、教材となる文章をチェックします。その際、禁止語集に登録されている言葉が教材の中に含まれていないかを確認します。もし含まれていれば、その言葉を削除したり、別の言葉に置き換えたりします。このようにして、人工知能が良くない情報を学習することを防ぎ、より信頼できる結果を出せるようにします。この作業は、まるで人間の子どもに教育をする際に、悪い言葉を使わないように教えるのと同じです。

禁止語集を作る際には、常に最新の情報に更新していくことが重要です。新しい言葉や表現が次々と生まれてくるため、定期的に見直し、必要に応じて追加や修正を行う必要があります。また、禁止語集に登録する言葉を選ぶ際には、慎重な判断が必要です。言葉の意味や文脈を考慮せずに、安易に言葉を追加すると、本来必要な情報まで排除してしまう可能性があります。そのため、専門家によるチェックや議論が必要不可欠です。適切な禁止語集を用いることで、人工知能が社会にとって有益な存在となり、より良い未来を築くために貢献できると期待されます。

言葉集の作成方法

言葉集を作る際には、その言葉集の目的をはっきりさせることが大切です。例えば、不適切な言葉を集めた言葉集を作るのか、特定の分野で使われる専門用語を集めた言葉集を作るのかなど、目的によって言葉集の内容は大きく変わってきます。

不適切な言葉を集めた言葉集を作る場合は、言葉の持つ意味合いをよく考える必要があります。ある言葉が、ある状況では不適切でも、別の状況では適切な場合もあります。例えば、医学の論文では、一般的には使われない言葉も、学術的な目的で使われることがあります。そのため、言葉集に入れる言葉は、使われる状況や目的を十分に考えて選ぶことが重要です。

言葉は時代とともに変化します。新しい言葉が生まれたり、既存の言葉の意味が変わったりすることもあります。そのため、一度作った言葉集をそのままにしておくのではなく、定期的に見直して、必要に応じて更新することが大切です。社会の変化や新しい言葉の登場に合わせて言葉集を更新することで、言葉集の質を高く保つことができます。これは、人工知能が社会の変化に対応し、適切な情報を学び続けるために必要な作業です。

また、言葉集を作る際には、様々な意見を聞くことも大切です。自分一人で言葉を選ぶのではなく、複数の人で話し合いながら言葉を選ぶことで、より客観的でバランスのとれた言葉集を作ることができます。特に、不適切な言葉を集めた言葉集を作る場合は、様々な立場の人から意見を聞くことで、偏った言葉集になることを防ぐことができます。

| 言葉集作成のポイント | 詳細 |

|---|---|

| 目的を明確にする | 不適切な言葉集か、専門用語集かなど、言葉集の目的を定める。 |

| 言葉の意味合いを考える | 言葉の持つ意味合い、特に文脈における適切性・不適切性を吟味する。状況によっては適切な場合もあるため、注意が必要。 |

| 状況や目的を考慮して言葉を選ぶ | 言葉の使用状況や目的を十分に考え、言葉を選ぶ。 |

| 定期的な見直しと更新 | 言葉は変化するため、定期的に言葉集を見直し、必要に応じて更新する。 |

| 様々な意見を聞く | 複数人で議論し、客観的でバランスのとれた言葉集を作成する。 |

言葉集の効果と限界

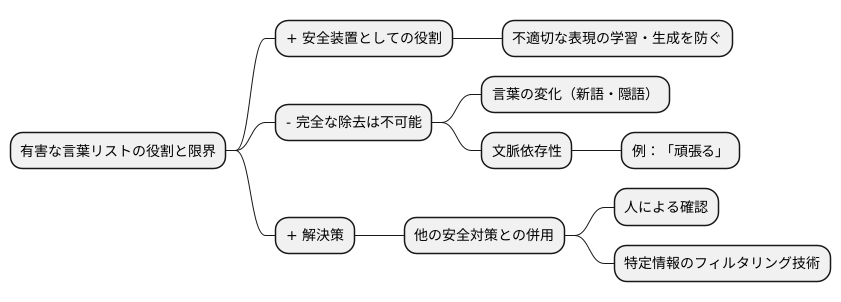

有害な言葉や表現を集めたリストは、人工知能の学習において、安全性を高める上で大切な役割を担っています。これは、人工知能が不適切な表現を学習したり、生成したりするのを防ぐための安全装置として機能するからです。

しかし、このリストだけで、すべての有害情報を完全に取り除くことはできません。なぜなら、言葉は生き物のように常に変化し、新しい俗語や隠れた表現が次々と生まれているからです。まるで、いたちごっこの様に、リストに載せるそばから新しい言葉が生まれてくるため、全てを網羅することは非常に難しいと言えるでしょう。

また、言葉の意味は、周りの状況や前後関係によって大きく変わることがあります。例えば、「頑張る」という言葉は、通常は良い意味で使われますが、無理を強いるような状況では、プレッシャーを与える言葉になってしまうこともあります。このように、リストに載っていない言葉でも、文脈によっては有害な意味を持つ場合があるため、リストだけに頼るのは危険です。

つまり、有害な言葉のリストは、それだけで完全な解決策となるわけではなく、他の安全対策と組み合わせて使うことが重要になります。例えば、人の目で確認する作業や、特定の情報をふるいにかける技術などを併用することで、より効果的に有害な情報を排除し、人工知能が安全に学習できる環境を整えることができます。人のチェックは、機械では判断できない微妙なニュアンスや文脈を理解する上で不可欠です。また、最新の技術を組み合わせることで、リストにない有害表現にも対応できる可能性が広がります。このように、様々な方法を組み合わせることで、より安全で信頼できる人工知能の開発を進めることができるのです。

言葉集以外の対策

有害な言葉や表現を集めたリスト(いわゆるブラックリスト)を使う以外にも、人工知能が安全に学習するための方法はたくさんあります。もちろん、そのようなリストを作ることは大切な取り組みの一つですが、それだけでは全ての問題を解決することはできません。人工知能が正しく、安全に学習するためには、様々な角度からの対策が必要です。

まず、人工知能に学習させるデータの選び方をより厳しくすることが重要です。質の悪いデータや偏ったデータを使えば、人工知能も偏った考え方や間違った知識を身につけてしまいます。そのため、学習データの内容を注意深く確認し、不適切な情報が含まれていないか、多様な意見や考え方が反映されているかなどをきちんとチェックする必要があります。

次に、人工知能が出した結果を人が確認する仕組みも大切です。人工知能はまだ完璧ではなく、時として誤った判断や予期しない行動をする可能性があります。人が常に結果を監視することで、問題があればすぐに修正したり、人工知能の学習方法を改善したりすることができます。これは、人工知能が安全に、そして人の役に立つように働くために欠かせない工程です。

さらに、人工知能が倫理的な判断をできるようにするための研究も進んでいます。これは、まるで人に道徳を教えるように、人工知能に正しいことと間違っていることを理解させるための技術です。この技術が確立されれば、人工知能はより倫理的に、そして人々の生活により役立つ存在になると期待されています。

これらの対策を一つずつ行うのではなく、複数の手法を組み合わせることで、より効果的な安全対策を築くことができます。人工知能技術は日々進歩しているので、安全対策も常に最新の状態に更新していく必要があります。人工知能の健全な発展のためには、常に新しい技術に目を向け、倫理的な視点も忘れずに、より良い方法を模索し続けることが大切です。

| 対策 | 説明 |

|---|---|

| 学習データの厳選 | 質の悪いデータや偏ったデータを使わないよう、学習データの内容を注意深く確認し、不適切な情報が含まれていないか、多様な意見や考え方が反映されているかなどをチェックする。 |

| 結果の監視と修正 | 人工知能が出した結果を人が確認する仕組みを作り、問題があればすぐに修正したり、人工知能の学習方法を改善したりする。 |

| 倫理的な判断能力の研究 | 人工知能が倫理的な判断をできるようにするための研究を進め、正しいことと間違っていることを理解させる。 |

| 複数手法の組み合わせ | 上記3つの対策を組み合わせることで、より効果的な安全対策を築く。 |

今後の展望

人工知能技術の発展は目覚ましく、今後ますます加速していくと考えられます。それと同時に、人工知能が安全に社会に役立つためには、有害情報の排除が欠かせません。そのため、不適切な表現を集めたブラック辞書のような安全対策も、より進化していく必要があります。

現在、ブラック辞書は特定の単語を登録し、それらを検出することで有害な情報を排除しています。しかし、言葉は文脈によって意味が変わるため、単語単体での判断には限界があります。「黒い」という言葉はネガティブな意味で使われることもありますが、「黒い服」のように単に色を表す場合もあります。

そこで、今後のブラック辞書は、文脈を理解した上で判断できるよう進化していくでしょう。例えば、より高度な自然言語処理技術を活用することで、言葉の意味だけでなく、前後の文脈や使われている状況なども考慮し、本当に有害な情報かどうかを判断できるようになります。これにより、誤検出を減らしつつ、より的確に有害情報を排除できるようになると期待されています。

さらに、ブラック辞書の作成や運用を自動化するための研究も進められています。現状では、ブラック辞書の更新は人手で行われている部分が多く、時間と手間がかかります。自動化技術が進めば、常に最新の有害情報に対応したブラック辞書を効率的に維持できるようになります。

こうした技術革新は、人工知能の学習の安全性と効率性を高め、様々な分野での応用を可能にします。医療、教育、交通など、あらゆる分野で人工知能が活躍することで、私たちの生活はより豊かになるでしょう。しかし、同時に倫理的な課題についても継続的に議論していく必要があります。技術開発と倫理的な検討を両輪として、人工知能の健全な発展を目指していくことが重要です。